Trong kỷ nguyên số hóa bùng nổ, Big Data nổi lên như một tài sản vô giá, định hình lại cách các doanh nghiệp vận hành và đưa ra quyết định chiến lược. Từ khối lượng dữ liệu khổng lồ, phức tạp, Big Data không chỉ là một khái niệm công nghệ mà còn là chìa khóa mở ra những insight khách hàng sâu sắc, giúp tối ưu hóa hiệu suất và tạo lợi thế cạnh tranh vượt trội trên thị trường.

Big Data là gì?

Big Data (hay dữ liệu lớn) là thuật ngữ dùng để chỉ các tập dữ liệu cực kỳ lớn, phức tạp và đa dạng đến mức các công cụ và phương pháp xử lý dữ liệu truyền thống không thể thu thập, lưu trữ, quản lý hay phân tích chúng một cách hiệu quả. Điều quan trọng không chỉ nằm ở quy mô của dữ liệu lớn mà còn ở khả năng trích xuất thông tin có giá trị và insight tiềm ẩn từ chúng.

Sự xuất hiện của Big Data là kết quả tất yếu của cuộc cách mạng công nghệ 4.0, khi mọi hoạt động từ giao dịch trực tuyến, tương tác mạng xã hội, đến dữ liệu từ các thiết bị IoT (Internet of Things) đều tạo ra một lượng thông tin khổng lồ mỗi giây. Khả năng xử lý và phân tích những luồng dữ liệu khổng lồ này đã mở ra những cơ hội chưa từng có cho các doanh nghiệp, từ việc hiểu rõ hành vi khách hàng đến dự đoán xu hướng thị trường.

Ví dụ điển hình về ứng dụng của Big Data là cách các nền tảng như Spotify, Netflix hay YouTube cá nhân hóa nội dung đề xuất cho từng người dùng, hoặc cách các sàn thương mại điện tử như Shopee, Lazada tối ưu trải nghiệm mua sắm dựa trên lịch sử duyệt web và mua hàng của bạn. Đây chính là minh chứng rõ ràng cho sức mạnh của dữ liệu lớn trong việc tạo ra giá trị thực tiễn.

Khái niệm Big Data và tầm quan trọng trong kỷ nguyên số hóa

Khái niệm Big Data và tầm quan trọng trong kỷ nguyên số hóa

Xem Thêm Bài Viết:

- Chiến Lược Social Media 2026: Sở Hữu Khán Giả, Kiến Tạo Giá Trị

- Tối Ưu Ngân Sách Với Chiến Lược Content Marketing Tiết Kiệm Chi Phí

- Data Lake là Gì? Khám Phá Nền Tảng Dữ Liệu Hiện Đại

- Những Sai Lầm SEO Phổ Biến Mà Marketer Thường Mắc Phải

- Quyết Định Bổ Nhiệm: Văn Bản Quan Trọng Trong Quản Lý Nhân Sự

Đặc trưng cốt lõi của Big Data: Mô hình 5V

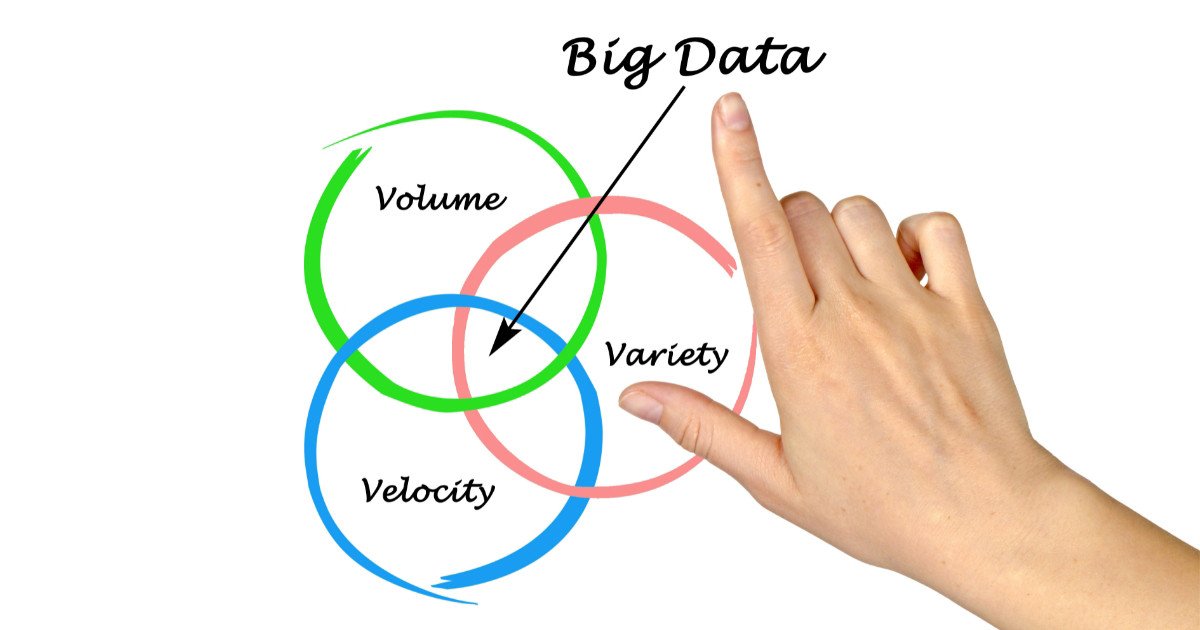

Để một tập dữ liệu được xem là Big Data, nó thường phải đáp ứng một số đặc điểm nhất định. Ban đầu, mô hình “3V” do Doug Laney đề xuất là phổ biến nhất, bao gồm Volume, Velocity và Variety. Tuy nhiên, ngày nay, mô hình “5V” đã được chấp nhận rộng rãi hơn, bổ sung thêm Veracity và Value, phản ánh đầy đủ hơn bản chất và tiềm năng của dữ liệu lớn.

Volume – Khối lượng dữ liệu khổng lồ

Volume đề cập đến quy mô khổng lồ của dữ liệu lớn. Trong kỷ nguyên số, dữ liệu được tạo ra với tốc độ chóng mặt từ vô số nguồn: các giao dịch kinh doanh, tương tác trên mạng xã hội, cảm biến IoT, video, âm thanh, và nhiều hơn nữa. Hàng terabyte, petabyte, thậm chí exabyte dữ liệu được sản sinh mỗi ngày, vượt xa khả năng xử lý của các hệ thống cơ sở dữ liệu truyền thống.

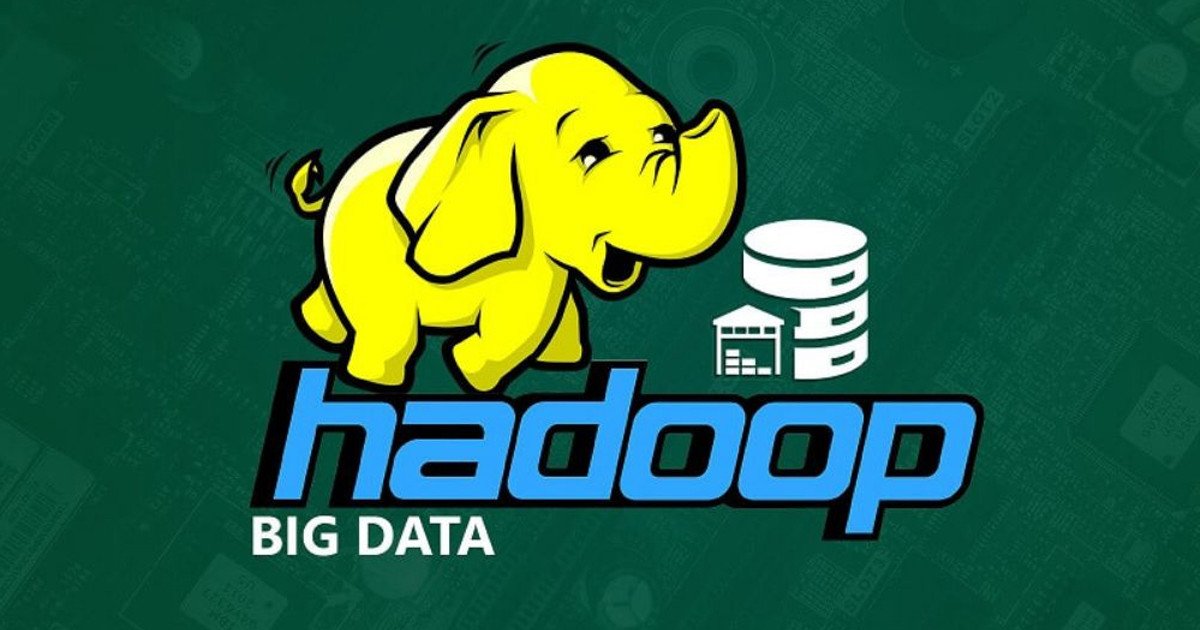

Trước đây, việc lưu trữ lượng dữ liệu lớn như vậy là một thách thức đáng kể về cả công nghệ và chi phí. Tuy nhiên, sự phát triển của các công nghệ lưu trữ phân tán và giá thành rẻ như Hadoop Distributed File System (HDFS) và Data Lake đã giúp các doanh nghiệp dễ dàng hơn trong việc thu thập và lưu trữ những tập dữ liệu khổng lồ này.

Velocity – Tốc độ xử lý dữ liệu cực nhanh

Velocity là tốc độ mà dữ liệu được tạo ra, thu thập và cần được xử lý. Trong nhiều trường hợp, Big Data đòi hỏi khả năng xử lý gần như thời gian thực để mang lại giá trị. Ví dụ, trên các mạng xã hội như Facebook hay Twitter, thông tin cũ sẽ nhanh chóng mất đi sự quan tâm của người dùng. Do đó, việc thu thập và phân tích các bài đăng, lượt thích, chia sẻ cần diễn ra với tốc độ cực nhanh, đôi khi chỉ trong mili giây.

Sự phát triển của Internet of Things (IoT) càng thúc đẩy yêu cầu về tốc độ xử lý dữ liệu, khi hàng tỷ thiết bị kết nối liên tục gửi về những luồng thông tin không ngừng nghỉ. Khả năng phân tích dữ liệu ngay khi nó được tạo ra (stream processing) là yếu tố then chốt giúp doanh nghiệp phản ứng nhanh chóng với các sự kiện, phát hiện gian lận hay đưa ra các quyết định kịp thời.

Variety – Tính đa dạng và linh hoạt của định dạng

Variety phản ánh sự đa dạng của các định dạng và loại dữ liệu mà Big Data bao gồm. Không chỉ giới hạn ở dữ liệu có cấu trúc từ các cơ sở dữ liệu truyền thống (như bảng tính Excel hay SQL), Big Data còn bao gồm một lượng lớn dữ liệu phi cấu trúc và bán cấu trúc. Điều này có thể là văn bản (email, tweet, đánh giá khách hàng), hình ảnh, video, âm thanh, dữ liệu nhật ký, và nhiều hơn nữa.

Việc tích hợp và phân tích các loại dữ liệu đa dạng này là một trong những thách thức lớn nhất của Big Data, đòi hỏi các công cụ và kỹ thuật phân tích phức tạp hơn để trích xuất thông tin hữu ích. Khả năng xử lý được sự đa dạng này giúp doanh nghiệp có cái nhìn toàn diện hơn về khách hàng và thị trường.

Veracity – Tính xác thực và độ tin cậy của dữ liệu

Veracity đề cập đến tính xác thực, chính xác và đáng tin cậy của dữ liệu. Với khối lượng và tốc độ tạo ra dữ liệu lớn như hiện nay, việc đảm bảo chất lượng dữ liệu là vô cùng quan trọng. Dữ liệu có thể không chính xác, không đầy đủ, lỗi thời hoặc có sai lệch do nhiều yếu tố như lỗi nhập liệu, cảm biến lỗi, hay thông tin không đáng tin cậy trên mạng xã hội.

Việc xử lý dữ liệu lớn đòi hỏi các quy trình để làm sạch, xác minh và chuẩn hóa dữ liệu nhằm giảm thiểu sự không chắc chắn và sai lệch. Một dữ liệu chất lượng kém có thể dẫn đến những phân tích sai lầm và quyết định kinh doanh không hiệu quả, làm giảm giá trị của toàn bộ hệ thống Big Data.

Value – Giá trị tiềm năng mà Big Data mang lại

Value là đặc trưng quan trọng nhất của Big Data, đề cập đến giá trị kinh doanh và thông tin mà nó có thể mang lại. Dù dữ liệu có lớn đến đâu, nhanh đến mấy hay đa dạng cỡ nào, nếu không thể trích xuất được insight và giá trị để hỗ trợ quyết định kinh doanh, thì nó cũng chỉ là “tiếng ồn”.

Mục tiêu cuối cùng của việc đầu tư vào Big Data là biến dữ liệu thô thành thông tin có ý nghĩa, giúp doanh nghiệp giải quyết các vấn đề phức tạp, cải thiện sản phẩm/dịch vụ, tối ưu hóa quy trình, tăng doanh thu và tạo lợi thế cạnh tranh. Giá trị này được tạo ra thông qua các kỹ thuật phân tích dữ liệu tiên tiến, máy học (Machine Learning) và trí tuệ nhân tạo (AI).

Mô hình 5V đặc trưng của dữ liệu lớn: Volume, Velocity, Variety, Veracity, Value

Mô hình 5V đặc trưng của dữ liệu lớn: Volume, Velocity, Variety, Veracity, Value

Phân loại Big Data: Các dạng dữ liệu phổ biến

Để quản lý và khai thác hiệu quả Big Data, việc hiểu rõ các loại dữ liệu là điều cần thiết. Dữ liệu lớn thường được phân loại dựa trên cấu trúc của chúng, bao gồm ba loại chính: dữ liệu có cấu trúc, dữ liệu phi cấu trúc và dữ liệu bán cấu trúc. Mỗi loại đều có những đặc điểm riêng và yêu cầu các phương pháp xử lý khác nhau.

Dữ liệu có cấu trúc

Dữ liệu có cấu trúc là loại dữ liệu có định dạng cố định, được tổ chức rõ ràng và lưu trữ trong các cơ sở dữ liệu quan hệ (relational databases) như SQL. Các thành phần của dữ liệu này được sắp xếp theo hàng và cột, với các trường được xác định trước, giúp việc truy cập, quản lý và phân tích trở nên đơn giản.

Các ví dụ phổ biến của dữ liệu có cấu trúc bao gồm thông tin khách hàng trong hệ thống CRM (tên, địa chỉ, số điện thoại), giao dịch tài chính (ngày, số tiền, loại giao dịch), hay bảng kê sản phẩm trong kho (mã sản phẩm, tên, số lượng). Nhờ cấu trúc rõ ràng, các nhà thiết kế và quản trị viên cơ sở dữ liệu có thể dễ dàng xác định các thuật toán đơn giản để tìm kiếm và phân tích, giúp doanh nghiệp nhanh chóng trích xuất thông tin chi tiết từ chúng.

Dữ liệu phi cấu trúc

Dữ liệu phi cấu trúc là bất kỳ tập hợp dữ liệu nào không được tổ chức hoặc xác định rõ ràng theo một mô hình cố định. Loại dữ liệu này hỗn loạn, không có cấu trúc được xác định trước, khiến việc xử lý và phân tích bằng các công cụ truyền thống trở nên khó khăn và phức tạp. Dữ liệu phi cấu trúc có thể thay đổi liên tục về định dạng và nội dung.

Các ví dụ điển hình của dữ liệu phi cấu trúc bao gồm các bài đăng trên mạng xã hội (tweet, bình luận, trạng thái), nội dung email, video trên YouTube, âm thanh ghi âm, hình ảnh, tài liệu văn bản (Word, PDF), và dữ liệu từ cảm biến. Để trích xuất giá trị từ dữ liệu phi cấu trúc, các doanh nghiệp cần áp dụng các kỹ thuật phân tích dữ liệu tiên tiến như xử lý ngôn ngữ tự nhiên (NLP), nhận dạng hình ảnh hay phân tích cảm xúc.

Dữ liệu bán cấu trúc

Dữ liệu bán cấu trúc là sự kết hợp giữa dữ liệu có cấu trúc và dữ liệu phi cấu trúc. Nó không tuân theo một sơ đồ cố định như dữ liệu có cấu trúc, nhưng vẫn chứa các thẻ hoặc định dạng tổ chức nhất định, cho phép phân loại và phân tích ở một mức độ nào đó. Dữ liệu bán cấu trúc thường được tạo ra trong các định dạng như JSON (JavaScript Object Notation), XML (Extensible Markup Language), hay dữ liệu log (nhật ký hệ thống).

Một ví dụ điển hình là email: trong khi nội dung chính của thư là dữ liệu phi cấu trúc, thì các thuộc tính như người gửi, người nhận, chủ đề, ngày tháng lại là dữ liệu có cấu trúc. Tương tự, dữ liệu từ các thiết bị đeo tay có thể cung cấp thông tin có cấu trúc (thời gian, địa điểm, nhịp tim) bên cạnh các ghi chú hoặc mô tả phi cấu trúc. Việc xử lý dữ liệu bán cấu trúc đòi hỏi sự linh hoạt trong cả công cụ và phương pháp tiếp cận.

Big Data bao gồm dữ liệu có cấu trúc, phi cấu trúc và bán cấu trúc

Big Data bao gồm dữ liệu có cấu trúc, phi cấu trúc và bán cấu trúc

Vai trò đột phá của Big Data trong doanh nghiệp

Với khả năng thu thập, lưu trữ, xử lý và phân tích các tập dữ liệu khổng lồ và phức tạp, Big Data đã trở thành một công cụ không thể thiếu, đóng vai trò then chốt trong mọi khía cạnh hoạt động của doanh nghiệp hiện đại, đặc biệt là trong bối cảnh chuyển đổi số mạnh mẽ. Dữ liệu lớn cung cấp những insight sâu sắc, giúp các tổ chức đưa ra quyết định sáng suốt và tối ưu hóa hiệu suất.

Cải thiện trải nghiệm khách hàng và cá nhân hóa

Big Data là công cụ mạnh mẽ giúp doanh nghiệp thấu hiểu và nhắm đúng đối tượng khách hàng mục tiêu một cách chính xác. Bằng cách phân tích hành vi duyệt web, lịch sử mua hàng, tương tác trên mạng xã hội và phản hồi từ khách hàng, doanh nghiệp có thể xây dựng một bức tranh toàn diện về insight khách hàng, từ đó dự đoán xu hướng mua sắm và điều chỉnh chiến lược kinh doanh.

Khả năng phân tích dữ liệu lớn cho phép các công ty điều chỉnh sản phẩm, dịch vụ và thông điệp tiếp thị phù hợp với từng phân khúc khách hàng hoặc thậm chí từng cá nhân. Điều này không chỉ giúp giảm chi phí cho các chiến dịch quảng cáo kém hiệu quả mà còn thúc đẩy lòng trung thành với thương hiệu, nâng cao trải nghiệm khách hàng thông qua các đề xuất được cá nhân hóa cao.

Big Data phân tích hành vi giúp cá nhân hóa và cải thiện trải nghiệm khách hàng

Big Data phân tích hành vi giúp cá nhân hóa và cải thiện trải nghiệm khách hàng

Nâng cao năng suất và hiệu quả vận hành

Các công cụ Big Data hiện đại cho phép các nhà khoa học và nhà phân tích dữ liệu kiểm tra lượng dữ liệu khổng lồ một cách nhanh chóng và hiệu quả. Điều này cung cấp cái nhìn tổng quan về các quy trình nội bộ, giúp phát hiện các điểm tắc nghẽn, lãng phí tài nguyên hoặc các khu vực cần cải tiến.

Việc phân tích dữ liệu lớn có thể giúp doanh nghiệp tối ưu hóa chuỗi cung ứng, quản lý kho hàng, và cải thiện quy trình sản xuất. Ví dụ, phân tích dữ liệu từ cảm biến trong nhà máy có thể dự đoán khi nào máy móc cần bảo trì, từ đó giảm thiểu thời gian ngừng hoạt động và tăng năng suất tổng thể.

Giảm thiểu rủi ro và phát hiện gian lận

Big Data được áp dụng rộng rãi trong việc cải thiện bảo mật và tuân thủ quy định pháp luật. Nhiều doanh nghiệp, đặc biệt trong lĩnh vực tài chính, sử dụng các phân tích dữ liệu lớn để phát hiện và ngăn chặn kịp thời các giao dịch gian lận, hành vi đáng ngờ. Bằng cách phân tích các mẫu giao dịch bất thường hoặc hành vi người dùng, hệ thống Big Data có thể cảnh báo sớm về các mối đe dọa tiềm ẩn.

Trong một môi trường kinh doanh đầy rủi ro và cạnh tranh khốc liệt, việc áp dụng Big Data giúp bảo vệ quyền lợi và tài sản thương hiệu, đồng thời giảm thiểu các tác động tiêu cực từ môi trường bên ngoài như rủi ro thị trường hay rủi ro hoạt động.

Tối ưu hóa giá cả và chiến lược định giá

Big Data đóng vai trò quan trọng trong quá trình định giá sản phẩm/dịch vụ cho doanh nghiệp. Bằng cách phân tích dữ liệu về giá cả của đối thủ cạnh tranh, xu hướng mua hàng của khách hàng, độ nhạy cảm về giá, và các yếu tố thị trường khác, doanh nghiệp có thể đưa ra các quyết định định giá linh hoạt và tối ưu.

Khả năng phân tích dữ liệu lớn giúp doanh nghiệp giảm thiểu thời gian nghiên cứu thị trường truyền thống mà vẫn thu được dữ liệu chất lượng cao để đưa ra chiến lược giá cạnh tranh và gia tăng lợi nhuận về lâu dài. Việc áp dụng các mô hình định giá động dựa trên Big Data ngày càng trở nên phổ biến.

Hỗ trợ đổi mới sản phẩm và dịch vụ

Đổi mới kinh doanh dựa trên những insight sâu sắc mà các nhà phân tích khám phá thông qua Big Data. Việc phát triển sản phẩm có thể được định hướng chính xác hơn bằng cách nắm bắt được người tiêu dùng thực sự nghĩ gì về sản phẩm/dịch vụ hiện có và mong muốn gì từ những cải tiến.

Big Data cho phép theo dõi phản hồi khách hàng theo thời gian thực từ các kênh khác nhau, giám sát xu hướng thị trường, và phân tích hoạt động của đối thủ cạnh tranh. Những phân tích này cung cấp cơ sở để các nhà quản lý đưa ra quyết định đổi mới kịp thời, đảm bảo sản phẩm/dịch vụ luôn bắt kịp và dẫn đầu xu hướng thị trường.

Tăng cường khả năng thích nghi và sáng tạo

Việc phân tích Big Data có thể hỗ trợ các doanh nghiệp trở nên sáng tạo và dễ thích nghi hơn trong môi trường kinh doanh biến động. Nhờ những insight từ dữ liệu, doanh nghiệp có thể hiểu rõ hơn về điểm mạnh, điểm yếu của đối thủ cạnh tranh, và đặc biệt là giải quyết “nỗi đau” (pain points) của khách hàng một cách hiệu quả và linh hoạt hơn.

Ngoài ra, với một lượng lớn dữ liệu sẵn có, doanh nghiệp có thể đánh giá rủi ro cho các ý tưởng mới, thử nghiệm các chiến lược khác nhau, và nhanh chóng điều chỉnh sản phẩm/dịch vụ. Điều này cung cấp cho những người ra quyết định thông tin cần thiết để đưa ra những lựa chọn chính xác và kịp thời, thúc đẩy văn hóa sáng tạo và phản ứng nhanh.

Phân tích Big Data thúc đẩy sự sáng tạo và khả năng thích nghi của doanh nghiệp

Phân tích Big Data thúc đẩy sự sáng tạo và khả năng thích nghi của doanh nghiệp

Quy trình hoạt động của Big Data: Từ dữ liệu thô đến Insight

Big Data không chỉ là một kho chứa dữ liệu khổng lồ mà còn là một hệ thống các quy trình liên tục để biến thông tin thô thành insight có giá trị. Với sự hỗ trợ của các công cụ và công nghệ mới, toàn bộ chu trình sống của dữ liệu lớn – từ thu thập, bảo quản, đến xử lý và phân tích – đã trở nên khả thi về mặt kỹ thuật và kinh tế. Dưới đây là các giai đoạn chính trong cách thức hoạt động của Big Data:

Thu thập dữ liệu

Thách thức đầu tiên mà nhiều tổ chức gặp phải trong hành trình Big Data là việc thu thập dữ liệu thô từ vô số nguồn khác nhau. Các nguồn này có thể bao gồm giao dịch kinh doanh, nhật ký hệ thống, dữ liệu từ thiết bị di động, cảm biến IoT, tương tác trên mạng xã hội, luồng video, và nhiều loại dữ liệu phi cấu trúc khác.

Một nền tảng Big Data hiệu quả sẽ đơn giản hóa giai đoạn này, cho phép các nhà phát triển nhập các loại dữ liệu đa dạng – từ dữ liệu có cấu trúc đến phi cấu trúc – với mọi tốc độ, từ xử lý theo thời gian thực (real-time processing) đến xử lý theo lô (batch processing). Công nghệ kết nối dữ liệu như Apache Kafka hay Apache Flume đóng vai trò quan trọng ở bước này.

Lưu trữ dữ liệu

Mọi hệ thống Big Data đều cần một kho lưu trữ an toàn, có khả năng mở rộng linh hoạt và bền vững để chứa dữ liệu trước hoặc sau khi xử lý. Do quy mô khổng lồ của dữ liệu lớn, các giải pháp lưu trữ truyền thống thường không đủ khả năng. Thay vào đó, các công nghệ lưu trữ phân tán như HDFS (Hadoop Distributed File System) hay các Data Lake dựa trên điện toán đám mây (cloud computing) được sử dụng.

Tùy thuộc vào nhu cầu cụ thể của doanh nghiệp, có thể cần các giải pháp lưu trữ tạm thời cho dữ liệu đang được truyền tải (data in motion) hoặc lưu trữ lâu dài cho dữ liệu đã qua xử lý. Sự linh hoạt trong lưu trữ là yếu tố then chốt để đảm bảo dữ liệu lớn luôn sẵn sàng cho phân tích.

Xử lý và Phân tích dữ liệu

Đây là giai đoạn cốt lõi biến dữ liệu thô thành định dạng có thể sử dụng được. Quá trình này thường bao gồm các bước như sắp xếp, tổng hợp, gộp, làm sạch, và thậm chí áp dụng các chức năng và thuật toán phân tích tiên tiến hơn. Các công cụ như Apache Spark, Hadoop MapReduce hay các nền tảng phân tích dữ liệu trên đám mây đóng vai trò quan trọng trong việc xử lý và chuyển đổi dữ liệu lớn.

Sau khi xử lý, các bộ dữ liệu đã được tinh chỉnh sẽ được lưu trữ để tiếp tục phân tích chuyên sâu hoặc chuẩn bị cho giai đoạn sử dụng thông qua các công cụ trực quan hóa dữ liệu và nghiệp vụ thông minh (Business Intelligence – BI). Các loại phân tích dữ liệu lớn cũng phát triển không ngừng:

- Phân tích mô tả (Descriptive Analytics): Giúp người dùng trả lời câu hỏi: “Điều gì đã xảy ra và tại sao?” Ví dụ bao gồm các báo cáo truyền thống, bảng điểm và bảng thông tin (dashboards) tóm tắt hiệu suất trong quá khứ.

- Phân tích dự đoán (Predictive Analytics): Giúp người dùng ước lượng xác suất của một sự kiện tương lai. Ví dụ bao gồm hệ thống cảnh báo sớm, phát hiện gian lận, ứng dụng bảo trì dự đoán và dự báo xu hướng thị trường.

- Phân tích theo quy định (Prescriptive Analytics): Cung cấp các khuyến nghị cụ thể (quy định) cho người dùng. Chúng giải đáp câu hỏi: “Tôi nên làm gì nếu ‘x’ xảy ra?” Loại phân tích này thường kết hợp các mô hình dự đoán với các quy tắc kinh doanh để đưa ra các hành động tối ưu.

Sử dụng và Trực quan hóa dữ liệu

Mục tiêu cuối cùng của Big Data là thu thập thông tin chuyên sâu và có giá trị từ tài sản dữ liệu của doanh nghiệp. Lý tưởng nhất, dữ liệu được cung cấp cho các bên liên quan thông qua các công cụ nghiệp vụ thông minh tự phục vụ (self-service BI) và các công cụ trực quan hóa dữ liệu linh hoạt. Điều này giúp người dùng khám phá bộ dữ liệu một cách nhanh chóng và dễ dàng, biến các con số và thông tin khô khan thành các biểu đồ, đồ thị dễ hiểu.

Tùy thuộc vào loại hình phân tích, người dùng cuối cũng có thể sử dụng dữ liệu dưới dạng “dự đoán” thống kê (trong trường hợp phân tích dự đoán) hoặc các hành động được đề xuất (trong trường hợp phân tích theo quy định). Khả năng trực quan hóa hiệu quả là chìa khóa để insight từ Big Data được truyền tải và áp dụng vào thực tế kinh doanh một cách nhanh chóng.

Quy trình hoạt động của Big Data từ thu thập đến phân tích và trực quan hóa dữ liệu

Quy trình hoạt động của Big Data từ thu thập đến phân tích và trực quan hóa dữ liệu

Ứng dụng thực tiễn của Big Data trong các ngành nghề

Big Data đã và đang cách mạng hóa cách thức hoạt động của nhiều ngành nghề khác nhau, mang lại những lợi ích to lớn về hiệu quả, đổi mới và khả năng cạnh tranh. Từ tài chính đến y tế, từ giáo dục đến marketing, dữ liệu lớn đang định hình lại tương lai.

Ngân hàng và Tài chính

Trong lĩnh vực ngân hàng, nơi thu thập một khối lượng dữ liệu khổng lồ từ các giao dịch, lịch sử tín dụng và tương tác khách hàng, Big Data đóng vai trò thiết yếu. Các ngân hàng phải không ngừng tìm kiếm các phương pháp mới để quản lý dữ liệu lớn không chỉ để hiểu và làm hài lòng khách hàng mà còn để giảm thiểu rủi ro, chống gian lận và tuân thủ các quy định pháp luật nghiêm ngặt.

Ứng dụng của Big Data giúp các ngân hàng:

- Xác định các địa điểm tiềm năng để mở chi nhánh mới dựa trên mật độ khách hàng và hành vi tiêu dùng.

- Dự đoán số lượng tiền mặt cần thiết tại các máy ATM hoặc chi nhánh cụ thể.

- Là xương sống của các ngân hàng số, hỗ trợ mọi hoạt động từ onboarding khách hàng đến xử lý giao dịch.

- Sử dụng máy học và AI để phát hiện các hành vi gian lận trong giao dịch thẻ tín dụng, chuyển khoản và kịp thời báo cáo cho chuyên viên an ninh.

- Phân tích hành vi vay trả nợ để đánh giá rủi ro tín dụng chính xác hơn.

Giáo dục

Ngành giáo dục cũng đang hưởng lợi đáng kể từ Big Data trong việc xử lý các dữ liệu về học sinh, sinh viên, giảng viên, tài liệu học tập và kết quả. Việc quản lý và phân tích dữ liệu lớn giúp tối ưu hóa quá trình dạy và học, đồng thời cải thiện hiệu suất tổng thể của hệ thống giáo dục.

Chức năng hữu ích của Big Data trong giáo dục bao gồm:

- Phân tích và quản lý hồ sơ học tập của sinh viên, bao gồm điểm số, thời gian học, và các khóa học đã hoàn thành.

- Sử dụng hệ thống quản lý Big Data để duy trì tính bảo mật cao cho dữ liệu nhạy cảm của học sinh.

- Cung cấp dữ liệu cần thiết về các hoạt động trong lớp, giúp giáo viên điều chỉnh phương pháp giảng dạy và đánh giá hiệu quả học tập.

- Hỗ trợ tạo ra các đề kiểm tra mang tính cá nhân hóa và giảm thiểu rủi ro rò rỉ đề thi.

- Phân tích xu hướng bỏ học sớm để đưa ra biện pháp hỗ trợ kịp thời.

Ví dụ, nhiều trường đại học lớn như Đại học Kinh tế Quốc dân đã triển khai các hệ thống quản lý học tập sử dụng Big Data để theo dõi thời gian sử dụng tài liệu, tổng kết quá trình và kết quả học tập của hàng chục ngàn sinh viên, từ đó đưa ra những điều chỉnh phù hợp cho chương trình đào tạo.

Big Data ứng dụng trong giáo dục để quản lý hồ sơ và phân tích hiệu quả học tập

Big Data ứng dụng trong giáo dục để quản lý hồ sơ và phân tích hiệu quả học tập

Ngành bán lẻ

Trong ngành bán lẻ, một khối lượng dữ liệu lớn luôn được tạo ra từ mọi giao dịch, tương tác trực tuyến và ngoại tuyến. Các doanh nghiệp bán lẻ thu thập dữ liệu này để đưa ra chiến lược phát triển sản phẩm, tối ưu hóa các chiến dịch marketing, và nâng cao trải nghiệm khách hàng.

Ứng dụng của Big Data trong ngành bán lẻ bao gồm:

- Xây dựng mô hình chi tiêu và hành vi mua sắm của từng khách hàng để đưa ra các đề xuất sản phẩm cá nhân hóa.

- Sử dụng phân tích dự đoán để nắm bắt và so sánh tỷ lệ cung – cầu, đồng thời tránh tích trữ các sản phẩm không phù hợp với nhu cầu thị trường.

- Xác định vị trí trưng bày sản phẩm tối ưu trên kệ hàng dựa vào thói quen và lộ trình mua sắm của khách hàng trong cửa hàng.

- Kết hợp phân tích dữ liệu từ thời điểm mua hàng, truyền thông xã hội, và giao dịch để xác định các sản phẩm phù hợp nhằm cung ứng cho khách hàng mục tiêu.

- Tối ưu hóa chuỗi cung ứng và quản lý kho hàng, giảm thiểu chi phí tồn kho.

Y tế

Ngành y tế đối mặt với khối lượng dữ liệu khổng lồ và nhạy cảm, từ hồ sơ bệnh án điện tử đến kết quả xét nghiệm, hình ảnh y tế. Big Data mang lại nhiều chức năng hữu ích để cải thiện chất lượng chăm sóc sức khỏe và hiệu quả vận hành.

Các chức năng của Big Data trong ngành y tế bao gồm:

- Cho phép người quản lý ca biết được tình trạng của bác sĩ cụ thể vào những thời điểm khác nhau, tối ưu hóa lịch trực.

- Dựa vào hồ sơ sức khỏe điện tử để theo dõi tình trạng của bệnh nhân theo thời gian, hỗ trợ chẩn đoán và điều trị.

- Đánh giá tình trạng bệnh thông qua các triệu chứng và xác định một số bệnh ở giai đoạn đầu, giúp can thiệp kịp thời.

- Sử dụng các thiết bị kỹ thuật số như vòng đeo tay thông minh, hệ thống Big Data có thể dựa vào đó để theo dõi tình trạng bệnh nhân từ xa và gửi báo cáo cho bác sĩ.

- Lưu trữ những hồ sơ nhạy cảm, có tính bảo mật cao một cách hiệu quả và an toàn.

- Ứng dụng Big Data cũng có thể báo cáo các khu vực có nguy cơ bùng phát dịch bệnh (như sốt rét, sốt xuất huyết, Covid-19) dựa trên dữ liệu địa lý và các yếu tố liên quan.

Ứng dụng Big Data trong ngành Y tế giúp quản lý bệnh án và dự đoán dịch bệnh

Ứng dụng Big Data trong ngành Y tế giúp quản lý bệnh án và dự đoán dịch bệnh

Truyền thông và giải trí

Các công ty truyền thông và giải trí cần đẩy mạnh chuyển đổi số để phân phối sản phẩm và nội dung nhanh nhất đến thị trường. Big Data có nhiều ứng dụng hữu ích giúp họ hiểu rõ khán giả và tối ưu hóa chiến lược nội dung.

Các ứng dụng bao gồm:

- Xác định thiết bị và thời điểm hiệu quả nhất để phân phối nội dung thông qua phân tích dữ liệu về hành vi tiêu thụ.

- Các công ty truyền thông, nghệ sĩ hoặc người phụ trách truyền thông có thể chọn địa điểm và tần suất phân phối tối ưu.

- Dựa trên mức độ phổ biến và tương tác của người dùng, nghệ sĩ có thể chọn thiết bị, hệ điều hành phù hợp để phân phối các sản phẩm, nội dung của mình.

- Cá nhân hóa trải nghiệm người dùng bằng cách đề xuất phim, nhạc, tin tức dựa trên lịch sử xem và sở thích.

- Phân tích dữ liệu từ phản hồi khán giả để cải thiện chất lượng nội dung và định hướng sản xuất trong tương lai.

Digital Marketing: Trọng tâm của Vị Marketing

Big Data đã góp phần không nhỏ vào sự phát triển mạnh mẽ của Digital Marketing như hiện tại. Trong một thế giới nơi mọi doanh nghiệp đều cần đến Digital Marketing để tiếp cận người tiêu dùng, dữ liệu lớn trở thành lợi thế cạnh tranh cốt lõi.

Các lợi ích của Big Data trong Digital Marketing bao gồm:

- Phân tích thị trường và đối thủ cạnh tranh toàn diện: Dữ liệu lớn giúp đánh giá mục tiêu kinh doanh, xác định cơ hội và thách thức để xây dựng kế hoạch marketing hiệu quả.

- Xác định khách hàng mục tiêu chính xác hơn: Bằng cách phân tích dữ liệu nhân khẩu học, sở thích, hành vi trực tuyến và thu nhập, doanh nghiệp có thể xây định rõ chân dung khách hàng và nhắm mục tiêu quảng cáo chính xác.

- Tối ưu hóa chiến lược nội dung SEO: Big Data giúp xác định các chủ đề, từ khóa, và nội dung được người dùng tìm kiếm nhiều nhất, từ đó xây dựng chiến lược nội dung thân thiện với công cụ tìm kiếm và thu hút lượng truy cập tự nhiên.

- Cá nhân hóa trải nghiệm quảng cáo: Tạo các đối tượng tương tự (lookalike audiences) thông qua việc sử dụng cơ sở dữ liệu đối tượng hiện có, giúp nhắm mục tiêu đến các khách hàng tiềm năng có đặc điểm tương tự, từ đó tăng tỷ lệ chuyển đổi và lợi nhuận.

- Đo lường hiệu quả chiến dịch: Big Data cho phép theo dõi và phân tích hiệu suất của các chiến dịch marketing theo thời gian thực, từ đó đưa ra điều chỉnh kịp thời để tối ưu hóa ROI (Return on Investment).

Giao thông vận tải

Ứng dụng Big Data vào ngành giao thông vận tải mang lại nhiều chức năng hữu ích, giúp tối ưu hóa luồng giao thông, quản lý logistics và nâng cao an toàn.

Các chức năng bao gồm:

- Kiểm soát các tuyến đường xe buýt, cung cấp thông tin thời gian thực cho người dùng để bắt xe đúng điểm dừng và đúng thời gian.

- Các công ty vận tải tư nhân có thể ứng dụng Big Data vào quản lý tài sản, kiểm tra và cải tiến công cụ, tối ưu hóa quy trình vận hành và lịch trình giao hàng.

- Ứng dụng Big Data vào lập kế hoạch lộ trình tối ưu, sắp xếp các phương tiện đi lại, và dự đoán tình hình giao thông để tránh tắc nghẽn.

- Phân tích dữ liệu từ cảm biến giao thông để cải thiện đèn tín hiệu, giảm ùn tắc và tai nạn.

- Hỗ trợ phát triển các hệ thống giao thông thông minh và xe tự lái.

Dịch vụ khách hàng

Ngoài chất lượng sản phẩm, dịch vụ tốt là yếu tố mà khách hàng kỳ vọng nhiều nhất. Trong giai đoạn mới tham gia vào thị trường hoặc muốn duy trì lợi thế, Big Data sẽ giúp chủ doanh nghiệp tìm ra những giải pháp và đề xuất tối ưu để hiểu khách hàng và tạo ra lợi thế cạnh tranh trong dịch vụ.

Cách thức ứng dụng Big Data vào dịch vụ khách hàng:

- Xác định yêu cầu khách hàng một cách chính xác, tập trung thực hiện các nhu cầu và kỳ vọng để làm hài lòng họ, thậm chí dự đoán trước các vấn đề.

- Phân tích hành vi, sự quan tâm và cảm xúc của khách hàng qua các kênh tương tác (email, chat, mạng xã hội) để tạo ra các sản phẩm/dịch vụ khách hàng phù hợp và thiết kế mô hình tiếp thị tối ưu.

- Nắm được sự tương đồng giữa các nhóm khách hàng và nhu cầu, kỳ vọng của họ, từ đó có thể xây dựng các chiến dịch quảng cáo, kịch bản chăm sóc khách hàng chính xác và mang lại hiệu quả cao.

- Cá nhân hóa trải nghiệm hỗ trợ khách hàng, cung cấp giải pháp nhanh chóng và phù hợp với từng trường hợp cụ thể.

Ứng dụng Big Data trong dịch vụ khách hàng

Ứng dụng Big Data trong dịch vụ khách hàng

Triển khai Big Data hiệu quả trong doanh nghiệp

Việc đưa Big Data vào hoạt động doanh nghiệp đòi hỏi một cách tiếp cận chiến lược và có hệ thống. Để tận dụng tối đa giá trị của dữ liệu lớn, các tổ chức cần tuân thủ một quy trình rõ ràng, từ việc xây dựng chiến lược đến việc ra quyết định dựa trên dữ liệu.

Lên chiến lược cho Big Data

Một chiến lược Big Data là một kế hoạch tổng thể giúp doanh nghiệp giám sát, cải tiến cách thu thập, lưu trữ, quản lý, chia sẻ và sử dụng dữ liệu ở cả trong và ngoài tổ chức. Khi phát triển chiến lược này, doanh nghiệp cần kết hợp chặt chẽ mục tiêu kinh doanh với các nguồn lực công nghệ hiện có.

Điều này có nghĩa là doanh nghiệp phải thực sự xem Big Data là một tài sản kinh doanh có giá trị, chứ không phải chỉ là một sản phẩm phụ của các ứng dụng. Chiến lược cần xác định rõ mục tiêu kinh doanh nào sẽ được giải quyết bằng Big Data, những loại dữ liệu nào cần thu thập, và làm thế nào để chuyển đổi dữ liệu thành insight có thể hành động.

Xác định các nguồn của Big Data

Big Data có thể đến từ vô số nguồn khác nhau, cả nội bộ và bên ngoài doanh nghiệp. Việc xác định và ưu tiên các nguồn dữ liệu phù hợp với mục tiêu kinh doanh là bước quan trọng.

- Streaming data: Đến từ Internet of Things (IoT) và các thiết bị được kết nối khác (thiết bị đeo tay, ô tô thông minh, thiết bị y tế) truyền vào hệ thống công nghệ thông tin. Doanh nghiệp cần xem xét và quyết định dữ liệu nào cần giữ lại và dữ liệu nào cần phân tích tức thì.

- Dữ liệu truyền thông xã hội: Bắt nguồn từ các tương tác trên Facebook, YouTube, Instagram, Twitter, LinkedIn. Big Data từ các nguồn này có thể ở dạng hình ảnh, video, giọng nói, văn bản, âm thanh và đặc biệt hữu ích trong việc tiếp thị và bán hàng, giúp hiểu cảm xúc và xu hướng của khách hàng.

- Publicly available data: Là dữ liệu có sẵn công khai từ một lượng lớn nguồn dữ liệu mở (open data), bao gồm dữ liệu chính phủ, nghiên cứu khoa học, và các cổng thông tin công cộng.

- Dữ liệu nội bộ: Từ các hệ thống kho dữ liệu (data warehouses), cơ sở dữ liệu giao dịch (transactional databases), hệ thống ERP/CRM, dữ liệu từ bộ phận chăm sóc khách hàng và các đối tác, nhà cung cấp.

Xác định nguồn dữ liệu lớn đa dạng từ IoT, mạng xã hội và các hệ thống nội bộ

Xác định nguồn dữ liệu lớn đa dạng từ IoT, mạng xã hội và các hệ thống nội bộ

Truy cập, quản lý và lưu trữ Big Data

Với sự bùng nổ mạnh mẽ của công nghệ, các hệ thống máy tính hiện đại đã cung cấp đủ tốc độ và tính linh hoạt cần thiết để nhanh chóng truy cập và xử lý lượng lớn các loại Big Data. Tuy nhiên, việc quản lý và lưu trữ hiệu quả vẫn là một thách thức.

Các doanh nghiệp cần có những phương pháp tích hợp dữ liệu từ nhiều nguồn khác nhau, đảm bảo chất lượng dữ liệu (data quality) và cung cấp khả năng quản lý dữ liệu (data governance) để thuận tiện cho việc phân tích. Điều này bao gồm việc thiết lập các kiến trúc Data Lake, sử dụng các giải pháp lưu trữ đám mây có khả năng mở rộng, và áp dụng các công cụ quản lý siêu dữ liệu (metadata management) để dễ dàng tìm kiếm và truy cập.

Phân tích Big Data

Mục đích cuối cùng của việc thu thập và quản lý Big Data là thu được giá trị và insight từ dữ liệu. Các kỹ thuật phân tích dữ liệu lớn bao gồm từ phân tích mô tả (chuyện gì đã xảy ra), phân tích chẩn đoán (tại sao chuyện đó xảy ra), phân tích dự đoán (chuyện gì có thể xảy ra), đến phân tích theo quy định (nên làm gì).

Các công nghệ như điện toán lưới (Grid computing) hay thực hiện các phân tích trên bộ nhớ đệm (in-memory analytics) với hiệu năng cao cho phép doanh nghiệp tận dụng toàn bộ Big Data để phân tích chuyên sâu. Việc này thường yêu cầu sự tham gia của các chuyên gia khoa học dữ liệu (Data Scientists) và kỹ sư Big Data để xây dựng các mô hình và thuật toán phức tạp.

Đưa ra quyết định hợp lý

Một dữ liệu chính xác, được quản lý và lưu trữ tốt có thể giúp quá trình phân tích chính xác và đưa ra quyết định hợp lý hơn. Trong môi trường kinh doanh cạnh tranh khốc liệt như hiện nay, doanh nghiệp cần tận dụng toàn bộ giá trị của Big Data, kể cả việc ra quyết định cũng cần dựa trên cơ sở dữ liệu chứ không phải bằng cảm tính hay suy đoán.

Big Data trao quyền cho các nhà lãnh đạo và quản lý để đưa ra quyết định dựa trên bằng chứng, tối ưu hóa các chiến lược từ marketing đến vận hành, và phản ứng nhanh chóng với sự thay đổi của thị trường. Vai trò của Big Data cho doanh nghiệp là không cần bàn cãi, giúp họ phân tích, dự đoán xu hướng và đưa ra những chiến lược phù hợp, mang lại nhiều giá trị, lợi nhuận cũng như lợi thế cạnh tranh trên thị trường.

Ra quyết định dựa trên Big Data giúp doanh nghiệp đạt được lợi thế cạnh tranh

Ra quyết định dựa trên Big Data giúp doanh nghiệp đạt được lợi thế cạnh tranh

Cơ sở hạ tầng IT hỗ trợ Big Data: Nền tảng vững chắc

Để xử lý và quản lý các dữ liệu lớn, phức tạp và đa dạng của Big Data, một cơ sở hạ tầng IT mạnh mẽ và linh hoạt là yếu tố then chốt. Cơ sở hạ tầng này phải được thiết kế để đáp ứng các yêu cầu về khối lượng, tốc độ và sự đa dạng của dữ liệu lớn.

- Hệ thống lưu trữ phân tán: Bao gồm các máy chủ và hệ thống lưu trữ được kết nối với nhau thông qua mạng, cho phép phân tán dữ liệu trên nhiều nút. Các hệ thống này, như HDFS (Hadoop Distributed File System) hay các giải pháp lưu trữ đám mây như Amazon S3, Google Cloud Storage, giúp lưu trữ và quản lý dữ liệu lớn một cách hiệu quả, đảm bảo tính khả dụng và chịu lỗi cao.

- Cụm máy chủ (Cluster): Sử dụng cụm máy chủ làm nơi lưu trữ và xử lý dữ liệu lớn. Cụm máy chủ cho phép mở rộng khả năng tính toán và lưu trữ một cách linh hoạt (horizontal scalability) để đáp ứng yêu cầu ngày càng tăng của Big Data. Các cụm này thường được quản lý bởi các hệ thống như YARN trong Hadoop hoặc Kubernetes.

- Công nghệ ảo hóa (Virtualization) và Containerization: Công nghệ ảo hóa (như VMware, Hyper-V) giúp tối ưu hóa việc sử dụng tài nguyên máy chủ bằng cách tạo ra các máy ảo. Trong khi đó, công nghệ container (như Docker, Kubernetes) cung cấp một môi trường nhẹ và nhất quán để triển khai các ứng dụng Big Data, giúp dễ dàng di chuyển và quản lý các dịch vụ dữ liệu.

- Mạng lưới (Networking) hiệu suất cao: Hỗ trợ kết nối giữa các thành phần hệ thống trong một cụm Big Data. Một mạng lưới chất lượng cao với băng thông lớn và độ trễ thấp là cực kỳ quan trọng để truyền tải dữ liệu hiệu quả giữa các nút xử lý và lưu trữ, đặc biệt khi làm việc với dữ liệu stream hoặc các tác vụ phân tích phức tạp.

- Bảo mật và an ninh dữ liệu: Cơ sở hạ tầng Big Data cần có các biện pháp bảo mật và an ninh mạnh mẽ để đảm bảo tính toàn vẹn, riêng tư và an toàn của dữ liệu nhạy cảm. Điều này bao gồm mã hóa dữ liệu (data encryption) khi lưu trữ và truyền tải, kiểm soát truy cập nghiêm ngặt, giám sát hoạt động và tuân thủ các quy định bảo mật dữ liệu (như GDPR, HIPAA).

- Khả năng mở rộng (Scalability) và Linh hoạt (Flexibility): Cơ sở hạ tầng IT cần thiết phải có khả năng mở rộng linh hoạt để đáp ứng nhu cầu gia tăng của dữ liệu Big Data theo thời gian. Đồng thời, nó cũng phải đủ linh hoạt để hỗ trợ nhiều loại công cụ và công nghệ Big Data khác nhau, cho phép doanh nghiệp điều chỉnh theo sự phát triển của công nghệ và nhu cầu kinh doanh.

Những yếu tố này cùng nhau tạo nên một cơ sở hạ tầng mạnh mẽ, đáng tin cậy để hỗ trợ việc xử lý và phân tích dữ liệu lớn của Big Data, giúp tạo ra những thông tin hữu ích và giá trị đột phá từ dữ liệu đó.

Các công nghệ tiên tiến dành cho Big Data

Sự phát triển của Big Data đã thúc đẩy sự ra đời và phát triển của nhiều công nghệ mới được thiết kế đặc biệt để giải quyết các thách thức về khối lượng, tốc độ và sự đa dạng của dữ liệu lớn. Những công nghệ này tạo thành một hệ sinh thái mạnh mẽ hỗ trợ toàn bộ quá trình từ thu thập đến phân tích và trực quan hóa Big Data.

Hệ sinh thái Hadoop

Hadoop là một trong những hệ sinh thái phần mềm mã nguồn mở phổ biến và có sự liên quan mật thiết nhất với Big Data. Apache Hadoop cung cấp một khuôn khổ đáng tin cậy và có khả năng mở rộng để lưu trữ và xử lý khối lượng dữ liệu lớn trên các nhóm máy tính sử dụng mô hình lập trình đơn giản. Công nghệ này giúp mở rộng từ một máy chủ sang hàng ngàn máy khác, mỗi máy lưu trữ dữ liệu cục bộ và cung cấp khả năng tính toán.

Dự án Hadoop bao gồm nhiều thành phần cốt lõi:

- Hadoop Common: Cung cấp các tiện ích và thư viện phổ biến hỗ trợ các mô-đun Hadoop khác.

- Hadoop Distributed File System (HDFS): Một hệ thống tệp phân tán cung cấp khả năng truy cập những dữ liệu ứng dụng cao, được thiết kế để chạy trên phần cứng thông thường.

- Hadoop YARN (Yet Another Resource Negotiator): Một khuôn khổ để lên kế hoạch làm việc và quản lý các tài nguyên cụm, cho phép nhiều ứng dụng khác nhau chạy trên cùng một cụm Hadoop.

- Hadoop MapReduce: Một hệ thống dựa trên YARN nhằm xử lý song song các tập dữ liệu lớn, chia nhỏ công việc thành các tác vụ nhỏ hơn và phân phối chúng trên toàn bộ cụm.

Hệ sinh thái Hadoop là nền tảng xử lý dữ liệu lớn Big Data phổ biến

Hệ sinh thái Hadoop là nền tảng xử lý dữ liệu lớn Big Data phổ biến

Apache Spark

Apache Spark thuộc một phần quan trọng trong hệ sinh thái Hadoop, nhưng nó là một khuôn khổ tính toán cụm mã nguồn mở độc lập, được sử dụng nhằm xử lý Big Data với tốc độ nhanh hơn nhiều so với MapReduce, đặc biệt là trong các tác vụ phân tích dữ liệu phức tạp và lặp lại. Apache Spark hiện đã trở thành một trong những khuôn mẫu xử lý Big Data phổ biến và quan trọng nhất.

Điểm nổi bật của Spark là khả năng xử lý dữ liệu trong bộ nhớ (in-memory processing), giúp tăng tốc đáng kể các tác vụ phân tích, máy học và xử lý dữ liệu stream. Spark có thể được triển khai theo nhiều cách khác nhau, tích hợp tốt với HDFS, Amazon S3, và nhiều nguồn dữ liệu khác.

Data Lakes

Data Lakes là một khái niệm lưu trữ dữ liệu mới, nơi chứa một khối lượng dữ liệu thô cực kỳ lớn ở định dạng gốc của chúng. Khác với Data Warehouses (kho dữ liệu truyền thống) lưu trữ dữ liệu có cấu trúc và đã được làm sạch, Data Lakes lưu trữ cả dữ liệu có cấu trúc, phi cấu trúc và bán cấu trúc mà không cần xử lý trước.

Sự phát triển của IoT và phong trào chuyển đổi số đã giúp Data Lakes tăng trưởng mạnh mẽ, vì chúng cung cấp sự linh hoạt để lưu trữ mọi loại dữ liệu từ mọi nguồn. Công nghệ này được thiết kế giúp người dùng dễ dàng truy cập vào một lượng lớn dữ liệu bất cứ khi nào họ có nhu cầu, cho phép các chuyên gia khoa học dữ liệu khám phá và phân tích dữ liệu mà không bị giới hạn bởi cấu trúc định sẵn.

NoSQL Databases

NoSQL Databases (Non-relational Databases) là hệ thống quản lý dữ liệu không yêu cầu một sơ đồ cố định (schema-less), được xem là lựa chọn hoàn hảo đối với những dữ liệu lớn, thô và phi cấu trúc mà các cơ sở dữ liệu quan hệ truyền thống khó có thể xử lý. NoSQL có nghĩa là “không chỉ SQL”, các cơ sở dữ liệu này có thể xử lý nhiều mô hình dữ liệu khác nhau (key-value, document, column-family, graph) một cách linh hoạt và có khả năng mở rộng ngang (horizontal scaling) cao.

Sự linh hoạt này giúp NoSQL đặc biệt phù hợp với các ứng dụng web và di động tạo ra lượng lớn dữ liệu phi cấu trúc như mạng xã hội, hồ sơ người dùng, hay các hệ thống quản lý nội dung.

In-memory Databases (Cơ sở dữ liệu trong bộ nhớ)

In-memory Databases (IMDB) là hệ thống quản lý cơ sở dữ liệu thường dựa vào RAM (bộ nhớ truy cập ngẫu nhiên) thay vì ổ đĩa cứng (HDD/SSD) để lưu trữ dữ liệu. Do truy cập RAM nhanh hơn đáng kể so với ổ đĩa, IMDB cho phép xử lý và phân tích Big Data với tốc độ cực kỳ cao, gần như tức thì.

Tốc độ vượt trội này làm cho IMDB trở thành một công nghệ quan trọng để phân tích Big Data theo thời gian thực, tạo ra các siêu dữ liệu (metadata) và kho dữ liệu khổng lồ cho các ứng dụng yêu cầu hiệu suất cao như giao dịch tài chính tần số cao (HFT), hệ thống đề xuất sản phẩm, hay các bảng điều khiển phân tích dữ liệu trực tiếp.

So sánh Big Data và Data Mining: Hai khái niệm bổ trợ

Big Data và Data Mining đều là những công nghệ và phương pháp xử lý dữ liệu quan trọng trong thế giới kỹ thuật số hiện nay. Mặc dù liên quan chặt chẽ và thường được sử dụng cùng nhau, chúng có mục đích, quy mô và ứng dụng khác nhau.

| Yếu tố so sánh | Big Data | Data Mining |

|---|---|---|

| Định nghĩa | Là khối lượng dữ liệu lớn và phức tạp, đòi hỏi các công nghệ và phương pháp xử lý đặc biệt để tìm kiếm thông tin hữu ích và triển khai các ứng dụng. | Là quá trình khai thác tri thức từ dữ liệu, bao gồm việc phân tích dữ liệu để khám phá các mối quan hệ tiềm ẩn, mô hình hóa, dự đoán và tìm kiếm các mẫu có ý nghĩa. |

| Mục đích chính | Giúp tổng hợp, lưu trữ, xử lý và phân tích dữ liệu lớn để quản lý hiệu quả và tạo ra giá trị. | Tập trung vào phát hiện các mối quan hệ, kiến thức mới và insight có thể hành động từ dữ liệu đã có. |

| Quy mô dữ liệu | Lớn, có thể đến hàng tỷ hoặc triệu GB (terabyte, petabyte, exabyte). | Thường làm việc với các tập dữ liệu đã được thu thập và làm sạch, quy mô nhỏ hơn so với Big Data (vài GB đến vài TB), nhưng vẫn có thể xử lý trên Big Data. |

| Công nghệ chính | Hadoop, Spark, NoSQL, Data Lakes, Kafka, công nghệ lưu trữ đám mây. | Các thuật toán máy học (Machine Learning), trí tuệ nhân tạo (AI), thống kê, kỹ thuật phân tích dữ liệu như phân loại (classification), gom cụm (clustering), phân tích hồi quy (regression analysis). |

| Áp dụng | Thường được áp dụng trong xây dựng cơ sở hạ tầng dữ liệu, quản lý hệ thống, điện toán đám mây, và xử lý luồng dữ liệu lớn trong các lĩnh vực kinh doanh, y tế, khoa học. | Thường được áp dụng trong phân tích dữ liệu, Marketing, bán hàng (đề xuất sản phẩm), quản lý chuỗi cung ứng (dự báo nhu cầu), và phát hiện gian lận. |

Tóm lại, Big Data cung cấp nền tảng và cơ sở hạ tầng cho việc lưu trữ và xử lý dữ liệu khổng lồ, trong khi Data Mining là tập hợp các kỹ thuật được áp dụng trên Big Data để khám phá các insight và kiến thức có giá trị. Cả hai đều là những mảnh ghép không thể thiếu trong bức tranh lớn về phân tích dữ liệu hiện đại.

Thách thức và khó khăn khi triển khai Big Data

Mặc dù Big Data mang lại nhiều hứa hẹn và lợi ích, nhưng việc triển khai và sử dụng nó cũng đi kèm với nhiều thách thức và khó khăn đáng kể. Các tổ chức phải vượt qua những rào cản này để thực sự khai thác được giá trị từ dữ liệu lớn của mình.

- Khối lượng và Tốc độ tăng trưởng Dữ liệu: Khối lượng dữ liệu tăng gấp đôi khoảng 2 năm một lần, đặt ra áp lực lớn lên khả năng lưu trữ và xử lý. Các tổ chức luôn phải cố gắng để bắt kịp với sự gia tăng này và tìm cách lưu trữ dữ liệu hiệu quả, nhưng trên thực tế, cơ sở hạ tầng và nguồn lực thường không đủ để chứa toàn bộ.

- Chất lượng Dữ liệu (Data Quality): Với sự đa dạng và tốc độ của Big Data, việc đảm bảo tính xác thực (Veracity) và chất lượng dữ liệu là một thách thức lớn. Dữ liệu có thể bị sai lệch, không đầy đủ, không nhất quán hoặc lỗi thời, dẫn đến phân tích sai lầm và quyết định kinh doanh kém hiệu quả. Việc làm sạch và chuẩn hóa dữ liệu đòi hỏi nhiều công sức và công nghệ.

- Bảo mật và Quyền riêng tư: Dữ liệu lớn thường chứa thông tin nhạy cảm về khách hàng hoặc hoạt động kinh doanh. Việc bảo vệ dữ liệu khỏi các cuộc tấn công mạng, vi phạm quyền riêng tư và đảm bảo tuân thủ các quy định như GDPR hay CCPA là một mối quan tâm hàng đầu và phức tạp.

- Thiếu hụt nguồn nhân lực: Có một khoảng cách lớn về kỹ năng trong lĩnh vực Big Data. Việc tìm kiếm các chuyên gia có kinh nghiệm về khoa học dữ liệu (Data Scientists), kỹ sư Big Data, kiến trúc sư dữ liệu có khả năng xây dựng và quản lý hệ thống Big Data là một thách thức lớn đối với nhiều doanh nghiệp.

- Chi phí đầu tư ban đầu cao: Triển khai cơ sở hạ tầng Big Data đòi hỏi khoản đầu tư đáng kể vào phần cứng, phần mềm, công nghệ lưu trữ và nguồn nhân lực chuyên biệt. Điều này có thể là rào cản đối với các doanh nghiệp nhỏ và vừa.

- Tích hợp dữ liệu đa dạng: Việc tích hợp dữ liệu từ nhiều nguồn khác nhau với các định dạng khác nhau (có cấu trúc, phi cấu trúc, bán cấu trúc) là một nhiệm vụ phức tạp, đòi hỏi các công cụ và quy trình ETL (Extract, Transform, Load) mạnh mẽ.

- Khả năng truy cập và sử dụng cho người dùng doanh nghiệp: Mặc dù Big Data chứa nhiều insight, việc biến những insight kỹ thuật thành thông tin dễ hiểu và có thể hành động cho các nhà quản lý và người dùng kinh doanh là một thách thức. Cần có các công cụ trực quan hóa và nghiệp vụ thông minh thân thiện với người dùng.

- Đạo đức và sự thiên vị trong dữ liệu: Các mô hình phân tích Big Data, đặc biệt là AI và máy học, có thể vô tình tạo ra hoặc khuếch đại sự thiên vị nếu dữ liệu đào tạo không công bằng hoặc không đầy đủ, dẫn đến các quyết định không công bằng hoặc phân biệt đối xử.

Thách thức về bảo mật và quản lý dữ liệu khi triển khai Big Data

Thách thức về bảo mật và quản lý dữ liệu khi triển khai Big Data

Lộ trình học Big Data và các chuyên ngành phù hợp

Học Big Data là một hành trình thú vị và đầy tiềm năng, mở ra nhiều cơ hội nghề nghiệp trong lĩnh vực công nghệ và phân tích dữ liệu. Để bắt đầu, bạn cần xây dựng nền tảng vững chắc với ba kỹ năng chính: kỹ năng lập trình, kỹ năng thống kê và kỹ năng phân tích.

- Kỹ năng lập trình: Bạn cần biết cách viết mã để làm việc với Big Data. Các ngôn ngữ lập trình phổ biến và được khuyến nghị cho Big Data bao gồm Python (với các thư viện như Pandas, NumPy, Scikit-learn), R (đặc biệt cho phân tích thống kê và hình ảnh hóa), và Java (cho các hệ thống Big Data cấp doanh nghiệp như Hadoop, Spark). Nắm vững một hoặc nhiều ngôn ngữ này là điều cần thiết.

- Kỹ năng thống kê: Bạn cần hiểu các khái niệm thống kê cơ bản và nâng cao để phân tích dữ liệu Big Data, đưa ra các kết luận có căn cứ và xây dựng các mô hình dự đoán. Các kiến thức về xác suất, kiểm định giả thuyết, hồi quy, và phân tích đa biến là rất quan trọng.

- Kỹ năng phân tích: Bạn cần biết cách phân tích dữ liệu để tìm ra thông tin có giá trị, xác định xu hướng, và giải quyết các vấn đề kinh doanh. Kỹ năng này bao gồm khả năng đặt câu hỏi đúng, tư duy phản biện, và khả năng truyền đạt insight một cách rõ ràng.

Bên cạnh đó, việc thực hành làm các dự án Big Data là cách tốt nhất để học và cải thiện các kỹ năng của bạn. Bạn có thể tìm thấy các dự án thực tế trên các trang web như Kaggle (nơi có các cuộc thi khoa học dữ liệu), GitHub (để tìm kiếm các dự án mã nguồn mở) hoặc xây dựng các dự án cá nhân với dữ liệu công khai.

Có nhiều chuyên ngành học liên quan đến Big Data, đào tạo các kiến thức sâu rộng về kỹ năng, công nghệ và chuyên môn để làm việc trong lĩnh vực này. Dưới đây là một số chuyên ngành học phổ biến liên quan đến Big Data:

- Khoa học máy tính (Computer Science): Tập trung vào lĩnh vực xử lý dữ liệu lớn, thu thập, lưu trữ và phân tích dữ liệu từ góc độ kỹ thuật. Học viên được trang bị kiến thức vững chắc về các ngôn ngữ lập trình, cấu trúc dữ liệu, thuật toán, hệ thống cơ sở dữ liệu, và các công nghệ phân tích dữ liệu cốt lõi.

- Khoa học dữ liệu (Data Science): Chuyên ngành này tập trung vào việc khai thác dữ liệu lớn để phát hiện ra thông tin hữu ích và kiến thức mới. Ngành Data Science đào tạo về xử lý dữ liệu, thống kê, máy học (Machine Learning), trí tuệ nhân tạo (AI) và kỹ năng trực quan hóa dữ liệu.

- Công nghệ thông tin (Information Technology): Liên quan đến quản lý, lưu trữ và phân tích dữ liệu lớn từ góc độ triển khai hệ thống và vận hành. Học viên nắm các kiến thức về hệ thống mạng, lưu trữ dữ liệu, bảo mật và phát triển ứng dụng phục vụ việc xử lý dữ liệu lớn.

- Hệ thống thông tin (Information Systems): Chuyên ngành này tập trung vào cầu nối giữa công nghệ và kinh doanh, trang bị kiến thức về cách thiết kế, triển khai và quản lý các hệ thống thông tin, bao gồm cả các hệ thống Big Data, để hỗ trợ quyết định kinh doanh.

- Thống kê (Statistics): Chuyên ngành thống kê giúp bạn biết cách xử lý và phân tích dữ liệu lớn để đưa ra các kết luận và dự đoán. Đào tạo chuyên sâu về thống kê mô tả, thống kê suy luận, mô hình hóa thống kê và ứng dụng trong Big Data.

- Kỹ thuật dữ liệu (Data Engineering): Tập trung vào việc xây dựng và duy trì các hệ thống (data pipelines) cho phép thu thập, lưu trữ, xử lý và phân phối Big Data. Đây là một vai trò kỹ thuật cao, yêu cầu kiến thức sâu về cơ sở dữ liệu, kiến trúc hệ thống và công nghệ điện toán đám mây.

- Quản lý công nghệ thông tin (Information Technology Management): Chuyên ngành này hướng tới việc quản lý và tối ưu hóa cơ sở hạ tầng IT để hỗ trợ xử lý dữ liệu lớn và phân tích dữ liệu hiệu quả từ góc độ quản lý và chiến lược kinh doanh.

Những chuyên ngành này cung cấp kiến thức chuyên sâu và kỹ năng cần thiết để làm việc trong lĩnh vực Big Data, nơi mà sự hiểu biết về xử lý dữ liệu lớn và phân tích thông tin là rất quan trọng để đưa ra các quyết định dựa trên dữ liệu.

Các nguồn tài liệu tham khảo chất lượng về Big Data

Để nắm vững và cập nhật kiến thức về Big Data, việc tham khảo các nguồn tài liệu uy tín là điều không thể thiếu. Dưới đây là một số loại nguồn tài liệu chất lượng mà bạn có thể sử dụng để nghiên cứu và học hỏi:

Sách chuyên sâu về Big Data

Có rất nhiều sách hay về Big Data bao gồm lý thuyết, công nghệ và ứng dụng thực tiễn. Một số cuốn sách nổi tiếng có thể kể đến như “Big Data: A Revolution That Will Transform How We Live, Work, and Think” của Viktor Mayer-Schönberger và Kenneth Cukier, hoặc các sách chuyên sâu về Hadoop, Spark, NoSQL từ các nhà xuất bản uy tín như O’Reilly. Các sách này cung cấp nền tảng kiến thức vững chắc và các ví dụ thực tế.

Khóa học trực tuyến

Các nền tảng học tập trực tuyến cung cấp vô số khóa học về Big Data từ cơ bản đến nâng cao, thường do các trường đại học hàng đầu hoặc chuyên gia trong ngành giảng dạy.

- Coursera và edX: Cung cấp các chuyên ngành (Specializations) và khóa học về Big Data, Khoa học dữ liệu, Kỹ thuật dữ liệu từ các trường đại học danh tiếng như Đại học Stanford, Đại học Illinois Urbana-Champaign, và IBM.

- Udemy và Coursera for Business: Cũng có nhiều khóa học về Big Data từ các giảng viên chuyên nghiệp, tập trung vào các công nghệ cụ thể như Spark, Hadoop, AWS Big Data services, hoặc Google Cloud Platform.

- DataCamp và Dataquest: Chuyên về khoa học dữ liệu và Big Data, cung cấp các khóa học thực hành với môi trường lập trình tích hợp.

Trang web và blog chuyên ngành

Theo dõi các trang web và blog chuyên ngành là cách tuyệt vời để cập nhật xu hướng mới, các công nghệ mới nổi và những case study thực tiễn.

- Các blog của các nhà cung cấp dịch vụ đám mây lớn: AWS Big Data Blog, Google Cloud Blog, Microsoft Azure Blog thường xuyên đăng tải các bài viết về công nghệ và ứng dụng Big Data của họ.

- Trang web của các dự án mã nguồn mở: Apache Hadoop, Apache Spark, Apache Kafka cung cấp tài liệu chính thức và hướng dẫn sử dụng.

- Các trang tin tức công nghệ và phân tích dữ liệu: Data Science Central, Towards Data Science (trên Medium), KDnuggets cung cấp các bài viết chất lượng cao từ cộng đồng chuyên gia.

Tài liệu trực tuyến và hướng dẫn (Tutorials)

Nhiều nguồn tài liệu trực tuyến miễn phí cung cấp các hướng dẫn chi tiết từng bước về cách sử dụng các công cụ Big Data cụ thể hoặc giải quyết các vấn đề thực tiễn.

- YouTube Channels: Các kênh chuyên về khoa học dữ liệu và Big Data thường có các bài giảng, hướng dẫn thực hành bằng video.

- GitHub Repositories: Nhiều dự án mã nguồn mở và các ví dụ code về Big Data có thể được tìm thấy trên GitHub.

- Tài liệu từ các cộng đồng lập trình: Stack Overflow, Reddit (các subreddit như r/BigData, r/datascience) là nơi bạn có thể đặt câu hỏi và tìm kiếm giải đáp từ cộng đồng.

Tạp chí và nghiên cứu khoa học

Đối với những ai muốn đi sâu vào lý thuyết và các nghiên cứu tiên tiến, các tạp chí khoa học và báo cáo nghiên cứu là nguồn tài liệu quý giá.

- IEEE Transactions on Knowledge and Data Engineering: Tạp chí khoa học uy tín về lĩnh vực dữ liệu và tri thức.

- Các báo cáo từ Gartner, Forrester, IDC: Cung cấp các phân tích thị trường, xu hướng và đánh giá công nghệ về Big Data.

- Các bài báo hội nghị chuyên ngành: Tham khảo các nghiên cứu mới nhất được trình bày tại các hội nghị như VLDB, SIGMOD, KDD.

Tầm quan trọng của Big Data không chỉ xoay quanh việc có bao nhiêu dữ liệu mà một doanh nghiệp sở hữu. Giá trị thực sự nằm ở cách mà doanh nghiệp sử dụng nó. Bằng cách lấy dữ liệu từ bất kỳ nguồn nào và phân tích nó, doanh nghiệp có thể tìm thấy câu trả lời cho việc hợp lý hóa quản lý tài nguyên, nâng cao hiệu quả hoạt động, tối ưu hóa quá trình phát triển sản phẩm, đồng thời thúc đẩy các cơ hội tăng trưởng và doanh thu mới.

Câu hỏi thường gặp về Big Data (FAQs)

1. Big Data khác gì so với dữ liệu truyền thống?

Big Data khác biệt ở ba đặc trưng chính: Khối lượng (Volume) khổng lồ, Tốc độ (Velocity) xử lý nhanh và Tính đa dạng (Variety) về định dạng (cả có cấu trúc, phi cấu trúc). Dữ liệu truyền thống thường nhỏ hơn, ít đa dạng hơn và có thể được xử lý bằng các công cụ cơ sở dữ liệu quan hệ thông thường. Big Data đòi hỏi các công nghệ và phương pháp phân tích dữ liệu chuyên biệt để trích xuất insight.

2. Tại sao Big Data lại quan trọng đối với doanh nghiệp?

Big Data cực kỳ quan trọng vì nó cung cấp khả năng hiểu rõ hơn về insight khách hàng, tối ưu hóa hoạt động, phát hiện gian lận, dự đoán xu hướng thị trường và hỗ trợ ra quyết định chiến lược dựa trên dữ liệu. Điều này giúp doanh nghiệp tăng cường lợi thế cạnh tranh, cải thiện hiệu suất và thúc đẩy đổi mới.

3. Những thách thức chính khi làm việc với Big Data là gì?

Những thách thức chính bao gồm: quản lý khối lượng dữ liệu khổng lồ và tốc độ tăng trưởng nhanh, đảm bảo chất lượng và tính xác thực của dữ liệu, bảo mật và quyền riêng tư thông tin nhạy cảm, thiếu hụt nhân lực có kỹ năng chuyên môn, chi phí đầu tư cao cho hạ tầng, và việc tích hợp các nguồn dữ liệu đa dạng.

4. Liệu các doanh nghiệp nhỏ có thể sử dụng Big Data không?

Có, các doanh nghiệp nhỏ vẫn có thể tận dụng Big Data. Thay vì đầu tư vào hạ tầng tốn kém, họ có thể sử dụng các dịch vụ Big Data dựa trên điện toán đám mây (như AWS, Azure, Google Cloud) với chi phí linh hoạt hơn, hoặc tập trung vào việc phân tích dữ liệu từ các nguồn sẵn có như Google Analytics, dữ liệu mạng xã hội, hoặc CRM để có được insight giá trị.

5. Big Data có liên quan gì đến AI và Machine Learning?

Big Data là nền tảng cho AI (Trí tuệ nhân tạo) và Machine Learning (Học máy). AI và Machine Learning cần một lượng lớn dữ liệu chất lượng cao để “học” và xây dựng các mô hình dự đoán hoặc tự động hóa. Big Data cung cấp nguồn dữ liệu dồi dào đó, giúp các thuật toán AI và Machine Learning trở nên chính xác và hiệu quả hơn.

6. Những nghề nghiệp phổ biến nào trong lĩnh vực Big Data?

Một số nghề nghiệp phổ biến trong lĩnh vực Big Data bao gồm: Kỹ sư Big Data (Big Data Engineer), Khoa học dữ liệu (Data Scientist), Nhà phân tích dữ liệu (Data Analyst), Kiến trúc sư dữ liệu (Data Architect), Kỹ sư Machine Learning (Machine Learning Engineer), và Chuyên viên Business Intelligence (BI Developer).

7. Big Data ảnh hưởng đến quyền riêng tư như thế nào?

Big Data có thể ảnh hưởng đến quyền riêng tư bằng cách thu thập và phân tích thông tin cá nhân chi tiết hơn bao giờ hết. Điều này đặt ra lo ngại về việc sử dụng dữ liệu không đúng mục đích, nguy cơ rò rỉ dữ liệu, và việc cá nhân bị định hình bởi các thuật toán. Các quy định như GDPR (Châu Âu) và CCPA (California) được ban hành để bảo vệ quyền riêng tư cá nhân trong kỷ nguyên Big Data.

8. Làm thế nào để đảm bảo chất lượng dữ liệu trong Big Data?

Đảm bảo chất lượng dữ liệu trong Big Data đòi hỏi một quy trình liên tục bao gồm: xác định nguồn dữ liệu đáng tin cậy, làm sạch dữ liệu (loại bỏ lỗi, trùng lặp), chuẩn hóa dữ liệu (đưa về cùng định dạng), kiểm tra tính nhất quán và hoàn chỉnh, và quản lý siêu dữ liệu (metadata) để theo dõi nguồn gốc và lịch sử dữ liệu. Việc sử dụng các công cụ quản lý chất lượng dữ liệu tự động cũng rất quan trọng.

9. Big Data có thể giúp ích cho Marketing số như thế nào?

Trong Marketing số, Big Data giúp doanh nghiệp hiểu sâu sắc insight khách hàng, từ đó cá nhân hóa các chiến dịch quảng cáo, tối ưu hóa nội dung SEO, nhắm mục tiêu đối tượng chính xác hơn, và đo lường hiệu quả chiến dịch theo thời gian thực. Điều này dẫn đến tỷ lệ chuyển đổi cao hơn, chi phí marketing hiệu quả hơn và tăng cường lòng trung thành của khách hàng.

10. Khoảng bao lâu để học về Big Data và trở thành chuyên gia?

Thời gian để học Big Data và trở thành chuyên gia phụ thuộc vào nền tảng kiến thức hiện có và mức độ cam kết của mỗi người. Để có kiến thức cơ bản và làm được các dự án đơn giản, có thể mất vài tháng học các khóa học trực tuyến. Để trở thành chuyên gia Big Data có kinh nghiệm, đòi hỏi nhiều năm học tập chuyên sâu (bậc đại học, thạc sĩ) và thực hành liên tục với các dự án thực tế, thường từ 2-5 năm hoặc hơn.

Tổng kết lại, Big Data không chỉ là một xu hướng nhất thời mà đã trở thành nền tảng cốt lõi cho mọi quyết định chiến lược trong kỷ nguyên số. Khả năng khai thác và phân tích dữ liệu lớn giúp doanh nghiệp không ngừng tối ưu hóa hoạt động, nắm bắt insight khách hàng sâu sắc và dẫn đầu cuộc đua cạnh tranh. Tại Vị Marketing, chúng tôi tin rằng việc hiểu và ứng dụng Big Data chính là chìa khóa để mở ra tiềm năng phát triển không giới hạn cho mọi tổ chức, định hình tương lai của marketing số và kinh doanh hiện đại.